Perusahaan AI Spanyol Multiverse Computing telah merilis HyperNova 60B 2602, versi terkompresi gpt-oss-120B OpenAI, dan menerbitkannya secara gratis di Memeluk Wajah.

Versi baru ini mengurangi kebutuhan memori model asli dari 61 GB menjadi 32 GB, dan Multiverse mengatakan bahwa versi ini mempertahankan kinerja pemanggilan alat yang hampir setara meskipun ada pengurangan ukuran sebesar 50%.

Secara teori, ini berarti model yang tadinya memerlukan infrastruktur berat dapat berjalan dengan perangkat keras yang jauh lebih sedikit. Bagi pengembang dengan anggaran terbatas atau keterbatasan energi, hal ini berpotensi menjadi keuntungan besar.

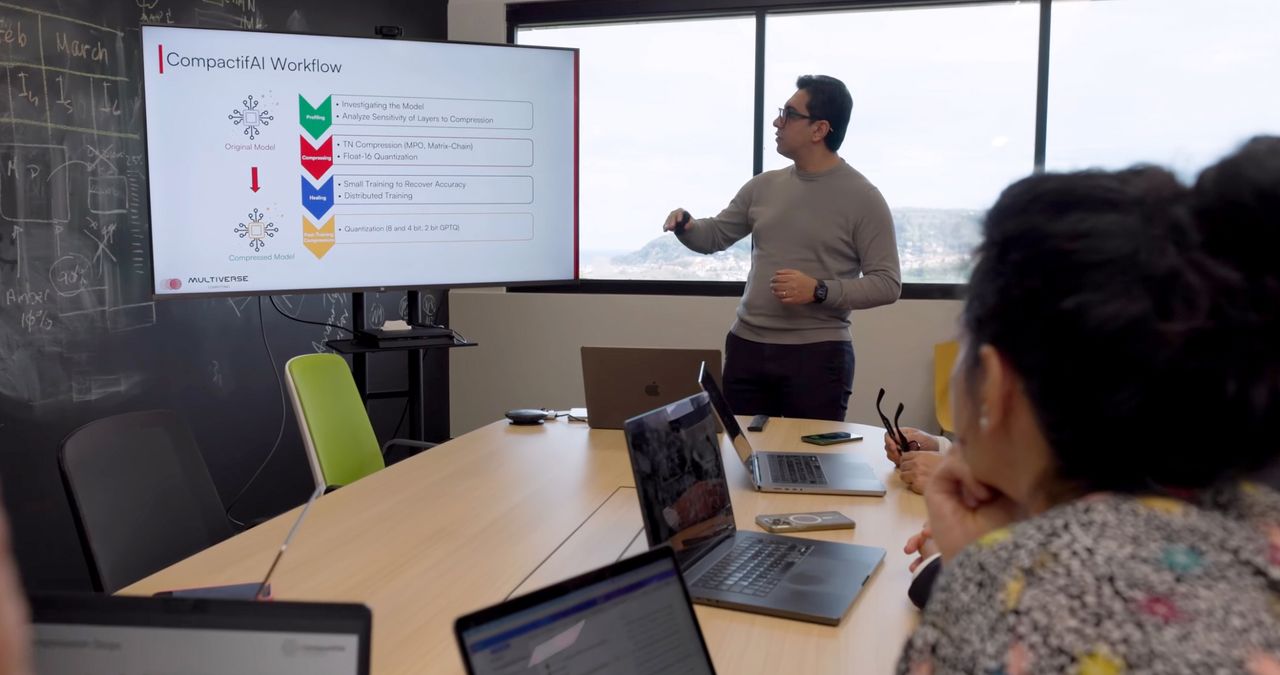

Teknologi CompactifAI

Multiverse mengklaim peningkatan dalam tolok ukur yang berfokus pada agen dibandingkan dengan rilis terkompresi sebelumnya. Dikatakan HyperNova 60B 2602 memberikan peningkatan 5x pada Tau2-Bench dan 2x pada Terminal Bench Hard.

Pengujian tersebut mengukur penggunaan alat dan alur kerja pengkodean, bukan balasan teks sederhana.

Teknologi CompactifAI perusahaan merestrukturisasi matriks bobot transformator menggunakan jaringan tensor yang terinspirasi kuantum.

Multiverse percaya bahwa kompresi yang efektif menawarkan alternatif selain membangun model yang semakin besar, dan menghubungkan pandangan tersebut dengan diskusi Eropa yang sedang berlangsung seputar kedaulatan AI, batasan infrastruktur, dan penggunaan energi – jadi untuk mengetahui lebih lanjut, saya berbicara dengan perusahaan tersebut tentang teknologi kompresinya.

- Bagaimana Anda bisa mengompresi LLM?

Multiverse Computing memampatkan model bahasa besar menggunakan teknologi CompactifAI miliknya, berdasarkan jaringan tensor yang terinspirasi kuantum.

Daripada hanya menghapus parameter, CompactifAI merestrukturisasi matriks bobot internal model transformator menjadi representasi jaringan tensor yang sangat efisien. Reformulasi matematis ini menangkap korelasi antar parameter dan menghilangkan redundansi struktural.

Proses ini diterapkan pasca pelatihan, artinya model asli tidak perlu dilatih ulang dan tidak diperlukan akses ke data pelatihan asli.

Dengan menggunakan pendekatan ini, CompactifAI dapat mengurangi penggunaan memori hingga sekitar 93% dan mengurangi jumlah parameter secara signifikan, sekaligus mempertahankan kinerja yang kuat di seluruh tugas.

Model terkompresi yang dihasilkan lebih kecil, lebih cepat, lebih hemat energi, dan lebih mudah diterapkan di lingkungan cloud, on-premise, dan edge.

- Bisakah Anda menerapkannya ke setiap LLM?

Ia bekerja pada model bahasa besar berbasis transformator, termasuk model fondasi padat, asalkan akses ke bobot model tersedia.

Teknologi ini bersifat agnostik arsitektur dalam keluarga transformator dan tidak memerlukan perubahan pada perilaku eksternal atau API model.

Efektivitas kompresi bergantung pada tingkat redundansi dalam model. Model yang besar dan memiliki parameter berlebih biasanya menawarkan potensi kompresi terbesar.

Tantangan teknis utama adalah menjaga akurasi model sekaligus mencapai rasio kompresi yang tinggi. Hal ini diatasi dengan mengontrol parameter dekomposisi tensor secara cermat untuk menyeimbangkan pengurangan ukuran dan stabilitas kinerja.

Tantangan lainnya adalah memastikan bahwa model terkompresi mempertahankan ketahanan di berbagai tugas, termasuk penalaran, kinerja multibahasa, dan kasus penggunaan khusus domain.

Terakhir, lingkungan penerapan sangat bervariasi. Kompresi harus dioptimalkan untuk target perangkat keras yang berbeda, persyaratan latensi, dan batasan operasional.

- Analogi yang bagus seperti apa?

Menulis ulang cetak biru, bukan menghapus batu bata: CompactifAI tidak hanya menghapus bagian dari model. Sebaliknya, ia menulis ulang cetak biru matematika sehingga struktur yang sama dapat direpresentasikan dengan lebih efisien.

Hal ini seperti mendesain ulang kerangka internal bangunan sehingga menggunakan lebih sedikit material namun tetap menjaga kekuatan dan fungsionalitas.

Analogi lainnya adalah menata ulang arsip besar-besaran menjadi sistem yang sangat terstruktur yang menghilangkan duplikasi. Pengetahuannya tetap utuh, namun dikodekan jauh lebih efisien.

- Bagaimana Anda menentukan hilangnya akurasi?

Hilangnya akurasi ditentukan dengan membandingkan model terkompresi dengan model asli pada tugas yang sama dan menilai metrik, lalu mengukur perubahannya.

Dalam praktiknya, hal ini mencakup evaluasi penggunaan alat. Mengurangi hilangnya kemampuan di sini memungkinkan alur kerja agen dan aplikasi pengkodean yang lebih canggih.

- Perusahaan lain (mungkin pesaing) sedang mengerjakan teknik yang sama

Teknik kompresi Multiverse Computing benar-benar unik, berdasarkan penelitian jaringan tensor yang terinspirasi kuantum oleh salah satu pendiri dan CEO Roman Orus.

Meskipun ada teknik lain yang tersedia untuk mengompresi model AI, teknik tersebut memiliki konsekuensi berupa hilangnya akurasi yang jauh lebih tinggi.

- Mengingat fakta bahwa LLM berkembang secara organik seiring berjalannya waktu, bagaimana masa depan kompresi Anda (mungkin implementasi perangkat keras?) atau yang lainnya?

Teknik kompresi ini juga dapat diterapkan pada LLM yang akan datang, artinya di masa depan, perangkat seperti mobil, ponsel, laptop, dll. akan dapat menjalankan model AI kecil atau nano yang sudah diinstal sebelumnya pada perangkat kerasnya.

- Apakah ini agnostik perangkat keras? Apakah ini berfungsi lebih baik pada beberapa perangkat keras (ASIC) dibandingkan yang lain?

Ya, ini tidak bergantung pada perangkat keras pada tingkat model: CompactifAI mengompresi bobot model pasca-pelatihan, sehingga model yang dihasilkan dapat diterapkan di cloud, on-prem, dan edge tanpa mengubah antarmuka eksternal model.

Percepatan inferensi bergantung pada apa yang membatasi Anda sebelumnya: Jika Anda terikat memori, model yang lebih kecil sering kali berjalan jauh lebih cepat dan lebih murah pada perangkat keras yang sama.

Ini tidak memerlukan ASIC, tetapi akselerator GPU/AI biasanya akan memberikan throughput tertinggi untuk inferensi transformator setelah model cocok dengan memori.

- Apa yang diandalkan oleh kompresi?

CompactifAI mengandalkan redundansi dalam matriks bobot transformator terlatih: model besar sering kali memiliki parameter berlebih, sehingga perilaku yang sama dapat direpresentasikan dengan parameter efektif yang lebih sedikit.

Alih-alih kompresi “gaya zip” yang umum, ia menggunakan faktorisasi model-aware (jaringan tensor yang terinspirasi kuantum) untuk menulis ulang matriks besar menjadi bentuk terstruktur dan lebih kecil sekaligus memitigasi trade-off akurasi.

- Apa yang mencegah orang lain meniru teknik/proses Anda? Analog dengan berbagai teknik kompresi yang tersedia (misalnya zip, rar, 7z dll)

Teknologi CompactifAI milik Multiverse Computing adalah pendekatan unik terhadap kompresi model AI, berdasarkan penelitian terhadap jaringan tensor yang terinspirasi kuantum oleh salah satu pendiri dan CEO Roman Orus, serta tim peneliti perusahaan itu sendiri.

Apa yang mencegah teknik peniruan adalah pengetahuan teknis yang diperlukan untuk mencapai tingkat kompresi yang tinggi tanpa mengorbankan akurasi.

CompactifAI dapat mengurangi ukuran model hingga 95% dengan hanya kehilangan akurasi 2-3%, dibandingkan dengan standar industri yang kehilangan akurasi 20-30% hanya setelah kompresi 50-60%.

Ikuti TechRadar di Google Berita Dan tambahkan kami sebagai sumber pilihan untuk mendapatkan berita, ulasan, dan opini pakar kami di feed Anda. Pastikan untuk mengklik tombol Ikuti!

Dan tentu saja Anda juga bisa Ikuti TechRadar di TikTok untuk berita, review, unboxing dalam bentuk video, dan dapatkan update rutin dari kami Ada apa juga.