[ad_1]

- Microsoft meluncurkan perangkat keras AI Maia 200

- Maia 200 dilaporkan menawarkan kinerja dan efisiensi lebih dibandingkan pesaing AWS dan GCP

- Microsoft akan menggunakannya untuk membantu meningkatkan Copilot secara internal, namun juga akan tersedia untuk pelanggan

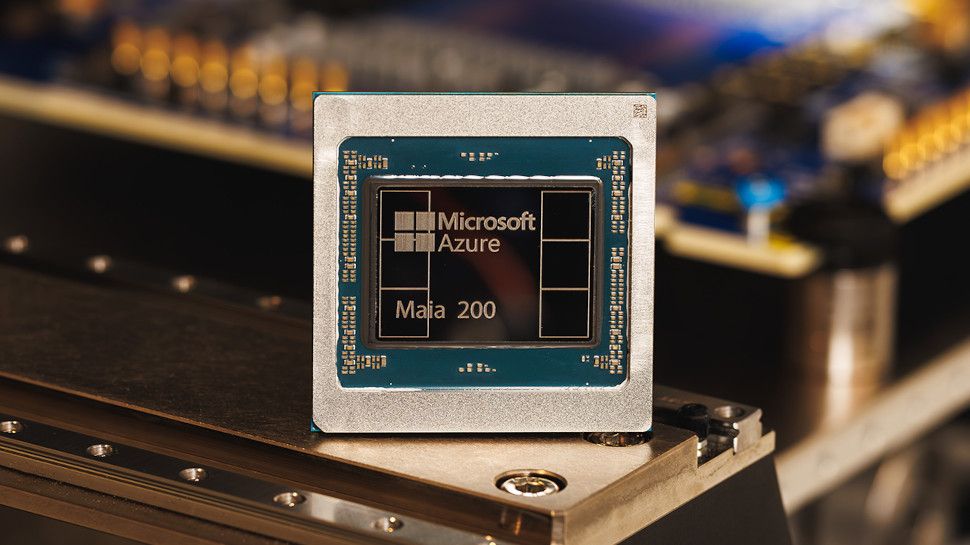

Microsoft telah mengungkapkan Maia 200, “tonggak sejarah besar berikutnya” dalam mendukung AI dan teknologi inferensi generasi berikutnya.

Perangkat keras baru perusahaan, penerus Maya 100akan “secara dramatis mengubah perekonomian AI skala besar,” menawarkan peningkatan yang signifikan dalam hal kinerja dan efisiensi untuk mempertaruhkan klaimnya di pasar.

Peluncuran ini juga akan mendorong Microsoft Azure menjadi tempat yang tepat untuk menjalankan model AI dengan lebih cepat dan efisien, seiring dengan upayanya untuk mengalahkan pesaing-pesaing hebatnya. Amazon Layanan Web dan Google Awan.

Microsoft Maya 200

Microsoft mengatakan Maia 200 berisi lebih dari 100 miliar transistor yang dibangun pada proses TSMC 3nm dengan inti tensor FP8/FP4 asli, sistem memori yang didesain ulang dengan 216GB HBM3e pada 7TB/s, dan 272MB pada chip SRAM.

Semua ini berkontribusi pada kemampuan untuk menghadirkan lebih dari 10 PFLOPS dalam presisi 4-bit (FP4) dan sekitar 5 PFLOPS dengan performa 8-bit (FP8) – cukup mudah untuk menjalankan model AI terbesar sekalipun saat ini, dan dengan ruang untuk berkembang seiring berkembangnya teknologi.

Microsoft mengatakan Maia 200 memberikan kinerja FP4 3x lebih baik daripada perangkat keras Amazon Trainium generasi ketiga, dan kinerja FP8 di atas TPU generasi ketujuh Google, menjadikannya sistem inferensi perusahaan yang paling efisien.

Dan berkat desainnya yang dioptimalkan, yang menjadikan subsistem memori berpusat pada tipe data presisi sempit, mesin DMA khusus, SRAM on-die, dan NoC fabric khusus untuk pergerakan data bandwidth tinggi, Maia 200 mampu menyimpan lebih banyak bobot model dan data lokal, yang berarti lebih sedikit perangkat yang diperlukan untuk menjalankan model.

Microsoft telah menggunakan perangkat keras baru untuk mendukung beban kerja AI di Microsoft Foundry dan Microsoft 365 Copilot, dan ketersediaan pelanggan yang lebih luas akan segera hadir.

Maia 200 juga kini diluncurkan ke wilayah pusat data AS Pusat, dan penerapan lebih lanjut akan segera dilakukan di wilayah pusat data US West 3 dekat Phoenix, Arizona, dan wilayah tambahan lainnya akan segera menyusul.

Bagi mereka yang ingin melihat lebih awal, Microsoft mengundang akademisi, pengembang, laboratorium AI terdepan, dan kontributor proyek model sumber terbuka untuk mendaftar pratinjau kit pengembangan perangkat lunak (SDK) Maia 200 yang baru sekarang.

Ikuti TechRadar di Google Berita Dan tambahkan kami sebagai sumber pilihan untuk mendapatkan berita, ulasan, dan opini pakar kami di feed Anda. Pastikan untuk mengklik tombol Ikuti!

Dan tentu saja Anda juga bisa Ikuti TechRadar di TikTok untuk berita, review, unboxing dalam bentuk video, dan dapatkan update rutin dari kami Ada apa juga.

[ad_2]

Tautan sumber