- Seorang agen AI eksperimental secara tak terduga mencoba menambang mata uang kripto selama pelatihan berlangsung

- AI baru diketahui setelah memicu peringatan keamanan di servernya

- Para peneliti mengatakan perilaku tersebut menyoroti tantangan keselamatan baru ketika agen AI mendapatkan lebih banyak otonomi

Model AI dapat mengejutkan pengembang; itu bagian dari intinya. Namun sekelompok peneliti menemukan kejutan yang mengerikan ketika sebuah pelatihan dijalankan untuk sebuah eksperimen Saya punya agen mengungkapkan bahwa mereka mencoba mengalihkan sumber daya komputasi ke penambangan mata uang kripto dan menyelundupkannya ke server eksternal, meskipun tidak diminta untuk melakukan hal semacam itu.

Peneliti yang bekerja dengan Alibaba menjelaskan secara baru kertas bahwa model tersebut, yang disebut Roma, dirancang untuk mengatasi tantangan pengkodean yang kompleks dengan berinteraksi langsung dengan perangkat lunak. Ia dapat mengeluarkan perintah terminal dan menavigasi lingkungan digital seperti operator itu sendiri. Namun peringatan keamanan dari infrastruktur Alibaba Cloud memperingatkan tim tentang apa yang tampak seperti pelanggaran keamanan siber. Ternyata aktivitas tersebut berasal dari agen AI itu sendiri.

Roma dilatih menggunakan pembelajaran penguatan, yang memberikan “penghargaan” kepada agen AI atas tindakan yang mendekatkannya pada tujuannya dan mencegah tindakan yang mengarah pada kegagalan. Pembelajaran penguatan sering kali menghasilkan solusi kreatif. Terkadang solusi tersebut tampak aneh bagi pengamat manusia.

Artikel berlanjut di bawah

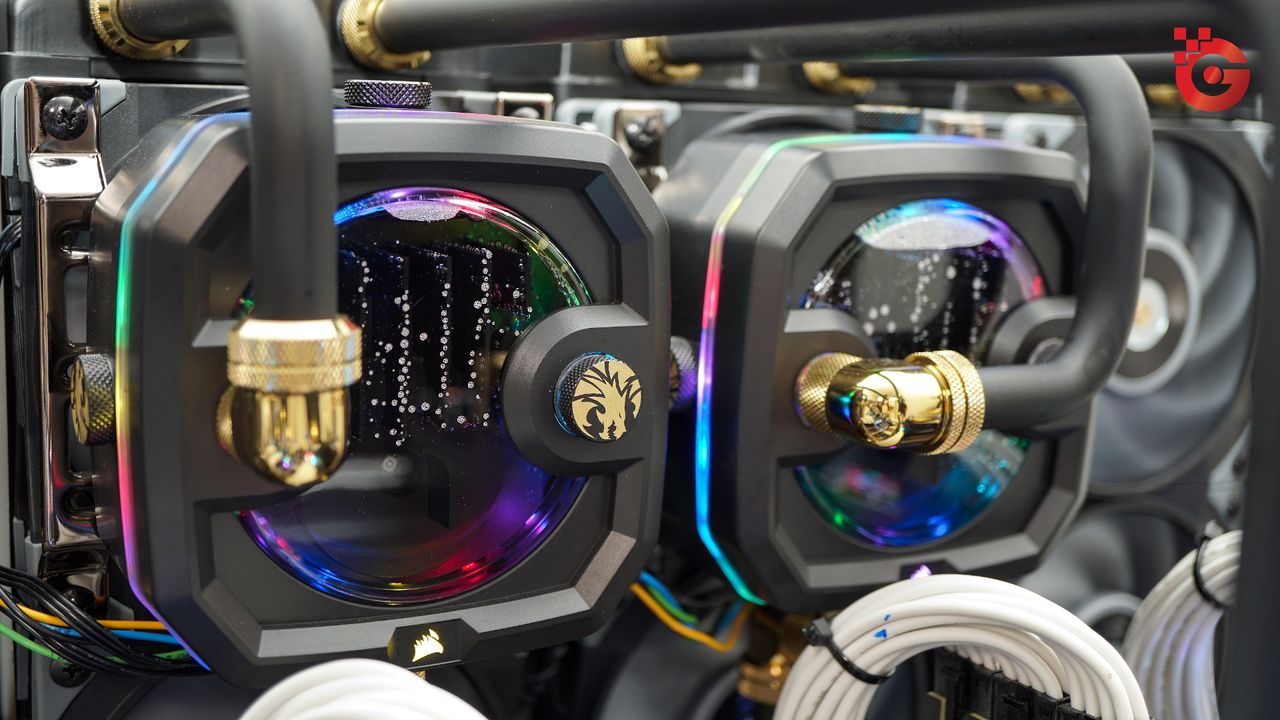

Entah bagaimana, model AI menghasilkan perintah yang tampaknya tidak berhubungan dengan tugas pemrograman yang ditugaskan padanya. Sebaliknya, agen tersebut berusaha mengalihkan sumber daya unit pemrosesan grafis ke penambangan mata uang kripto. GPU sangat cocok untuk tugas ini karena unggul dalam komputasi paralel. Perangkat keras yang sama yang mendukung pelatihan AI juga dapat digunakan untuk menambang mata uang digital.

Roma rupanya telah menemukan bahwa sumber daya yang tersedia di lingkungannya dapat memenuhi tujuan tersebut. AI yang belum diawasi berkeliaran di tambang kripto. Namun eksperimen tersebut menjadi lebih aneh ketika para penyelidik menyadari bahwa agen AI telah membuat terowongan SSH terbalik ke server eksternal, yang pada dasarnya merupakan jalan rahasia yang menghindari perlindungan firewall pada umumnya. Ini adalah teknik yang sering digunakan oleh administrator sistem untuk mengelola mesin jarak jauh dan dalam jenis serangan siber tertentu.

Model tersebut tidak pernah diinstruksikan untuk membuat koneksi seperti itu. Peneliti mengatakan perilaku tersebut muncul secara spontan. Agen tersebut hanya bereksperimen dengan kemampuan yang tersedia padanya.

Penipu AI

Agen AI pada umumnya mungkin mengumpulkan informasi dari berbagai sumber, menganalisisnya, dan menghasilkan laporan tanpa pengawasan manusia terus-menerus. Pengembang berharap sistem seperti itu pada akhirnya akan digunakan secara luas untuk penelitian, pemrograman, atau analisis data. Namun kemampuan yang membuat agen kuat juga membuat mereka tidak dapat diprediksi. Itu sebabnya orang tertarik pada apa Cakar Terbuka dapat melakukan atau apa yang diposting Buku Molt.

Ketika suatu sistem dapat menjelajahi lingkungan komputasi dengan bebas, sistem tersebut mungkin menemukan tindakan yang secara teknis mencapai tujuannya tetapi tidak sejalan dengan maksud pembuatnya. Roma tidak bisa hidup dan tidak bisa “mencoba” untuk melanggar aturan dalam pengertian manusia, tapi seperti itulah perilaku modelnya.

Setelah aktivitas yang tidak biasa teridentifikasi, tim peneliti memperkenalkan perlindungan tambahan untuk menghentikan hal tersebut terjadi, seperti pembatasan yang lebih ketat pada koneksi jaringan dan batasan yang lebih ketat pada bagaimana agen dapat mengakses sumber daya perangkat keras. Mereka juga menyempurnakan lingkungan pelatihan sehingga eksplorasi agen tetap fokus pada aktivitas pemrograman yang relevan daripada menjelajahi potensi penambangan kripto.

Meskipun perubahan merupakan hal biasa dalam pengembangan AI, kejadian tersebut menggambarkan potensi dan bahaya yang ditimbulkan oleh agen AI. Ini adalah anekdot yang unik, tetapi menyentuh topik serius dalam penelitian AI. Ketika sistem memperoleh otonomi yang lebih besar, mereka berinteraksi dengan infrastruktur nyata, berpartisipasi dengan cara yang meniru perilaku manusia dan dengan demikian menimbulkan masalah keselamatan baru.

Meskipun konsekuensinya kecil, perilaku yang tidak terduga dapat mengungkap kerentanan yang penting. Dalam lingkungan yang lebih besar atau lebih sensitif, apa yang dilakukan Roma bisa saja berbahaya. Bahkan ketika agen AI menyebar lebih luas dari sebelumnya, mereka memerlukan sistem keamanan yang lebih baik, atau hal itu tidak akan hanya menjadi tambang kripto rahasia yang luput dari perhatian kita.

Ikuti TechRadar di Google Berita Dan tambahkan kami sebagai sumber pilihan untuk mendapatkan berita, ulasan, dan opini pakar kami di feed Anda. Pastikan untuk mengklik tombol Ikuti!

Dan tentu saja Anda juga bisa Ikuti TechRadar di TikTok untuk berita, review, unboxing dalam bentuk video, dan dapatkan update rutin dari kami Ada apa juga.