- Micron memperkenalkan modul LPDDR5x 256GB padat yang ditujukan khusus untuk server AI

- Delapan modul SOCAMM2 dapat mendorong kapasitas memori server hingga 2TB

- Beban kerja inferensi AI semakin menggeser hambatan kinerja terhadap kapasitas memori sistem

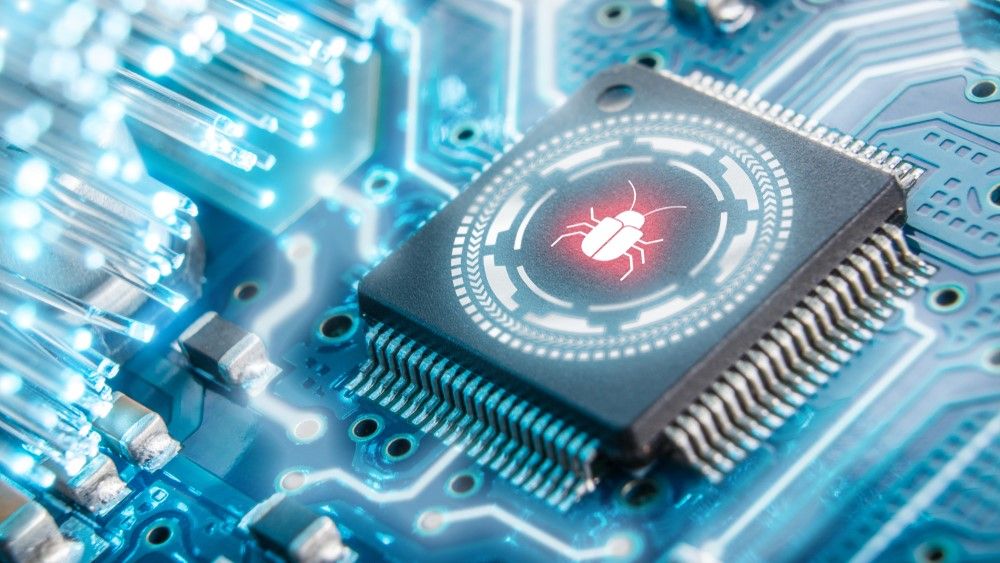

Model bahasa besar (LLM) dan jalur inferensi modern semakin menuntut kumpulan memori yang sangat besar, memaksa vendor perangkat keras untuk memikirkan kembali arsitektur memori server.

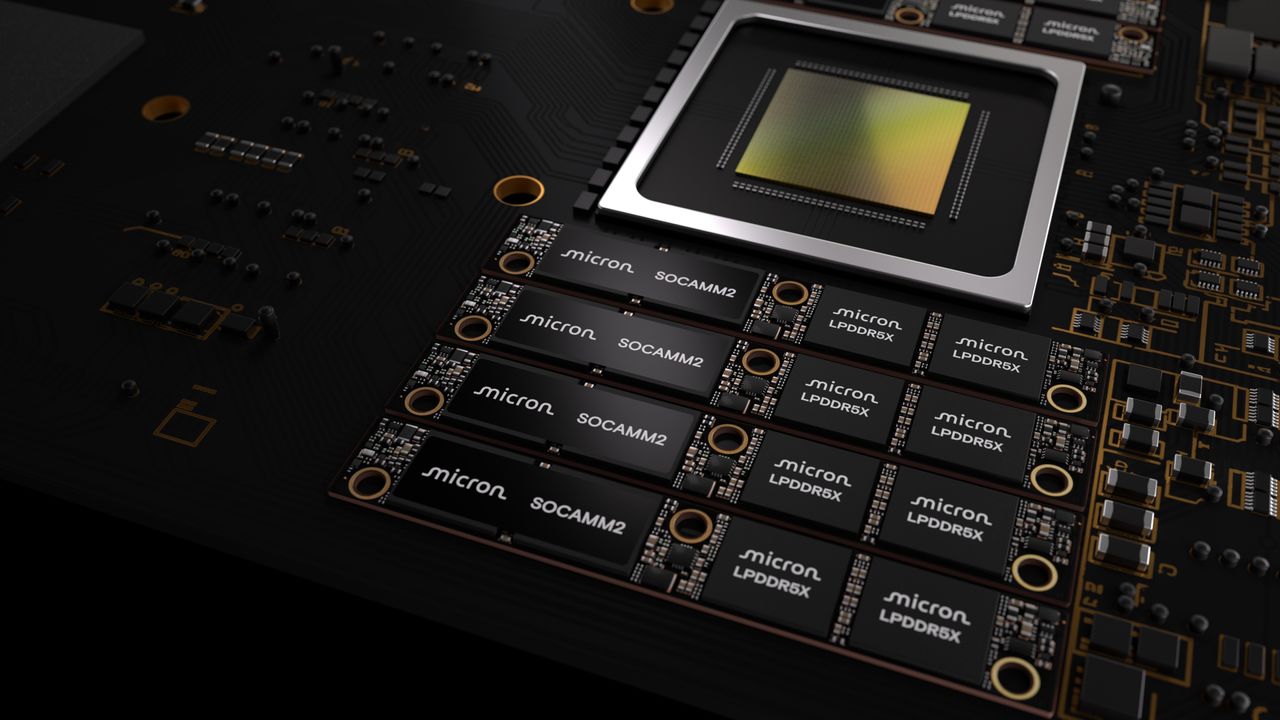

Micron kini telah memperkenalkan modul memori SOCAMM2 256GB yang ditujukan untuk pusat data sistem di mana kapasitas, bandwidth, dan efisiensi daya semuanya mempengaruhi kinerja secara keseluruhan.

Modul ini mengandalkan 64 chip LPDDR5x 32 GB monolitik, membentuk paket LPDRAM padat yang mengatasi peningkatan jejak memori yang dibutuhkan oleh beban kerja AI kontemporer.

Artikel berlanjut di bawah

Menskalakan kapasitas memori untuk platform server AI

Modul ini juga meningkatkan memori maksimum yang tersedia per konfigurasi prosesor. Ketika delapan modul SOCAMM2 ini dipasang di server delapan saluran CPUtotal kapasitas LPDRAM bisa mencapai 2TB.

Angka tersebut melebihi generasi modul 192GB sebelumnya sekitar sepertiganya, memungkinkan sistem mengakomodasi jendela konteks yang lebih besar dan tugas inferensi yang lebih menuntut.

Micron menggambarkan desain SOCAMM2 lebih efisien daripada modul memori server konvensional.

“Penawaran SOCAMM2 256GB dari Micron memungkinkan solusi memori terpasang CPU yang paling hemat daya untuk AI dan HPC,” kata Raj Narasimhan, wakil presiden senior dan manajer umum Unit Bisnis Memori Cloud Micron.

“Kepemimpinan kami yang berkelanjutan dalam solusi memori berdaya rendah untuk aplikasi pusat data telah secara unik memposisikan kami untuk menjadi yang pertama menghadirkan die LPDRAM monolitik 32 Gb, membantu mendorong adopsi industri terhadap arsitektur sistem berkapasitas tinggi yang lebih hemat daya.”

Perusahaan mengatakan modul LPDRAM baru mengkonsumsi sekitar sepertiga daya RDIMM serupa dan hanya menempati sepertiga dari tapak fisik.

Mengurangi kebutuhan energi dan ukuran modul yang lebih kecil memungkinkan kepadatan rak yang lebih tinggi dalam penerapan pusat data yang besar, sementara daya memori yang lebih rendah mengurangi beban termal dan biaya infrastruktur.

Arsitektur SOCAMM2 juga mengikuti desain modular yang dimaksudkan untuk menyederhanakan pemeliharaan dan perluasan di masa depan.

Format ini mendukung sistem server berpendingin cairan dan dapat mengakomodasi kapasitas tambahan seiring dengan meningkatnya kebutuhan memori seiring dengan kompleksitas model dan skala kumpulan data.

Micron menyatakan modul SOCAMM2 256GB dapat mempengaruhi operasi inferensi tertentu dalam arsitektur memori terpadu.

Perusahaan melaporkan peningkatan lebih dari 2,3x dalam waktu-ke-token pertama selama inferensi konteks panjang ketika modul digunakan untuk pembongkaran cache nilai kunci.

Dalam beban kerja CPU mandiri, konfigurasi LPDRAM dilaporkan memberikan kinerja per watt 3x lebih baik dibandingkan dengan modul memori server mainstream.

Portofolio LPDRAM perusahaan mencakup komponen mulai dari 8 GB hingga 64 GB dan modul SOCAMM2 mulai dari 48 GB hingga 256 GB, dan sampel pelanggan modul SOCAMM2 256 GB sudah dikirimkan.

Ikuti TechRadar di Google Berita Dan tambahkan kami sebagai sumber pilihan untuk mendapatkan berita, ulasan, dan opini pakar kami di feed Anda. Pastikan untuk mengklik tombol Ikuti!

Dan tentu saja Anda juga bisa Ikuti TechRadar di TikTok untuk berita, review, unboxing dalam bentuk video, dan dapatkan update rutin dari kami Ada apa juga.