- Hyperlink berjalan sepenuhnya pada perangkat keras lokal, menjaga setiap pencarian tetap pribadi

- Aplikasi ini mengindeks folder data besar di PC RTX dalam hitungan menit

- Inferensi LLM pada Hyperlink memiliki kecepatan dua kali lipat dengan pengoptimalan terbaru Nvidia

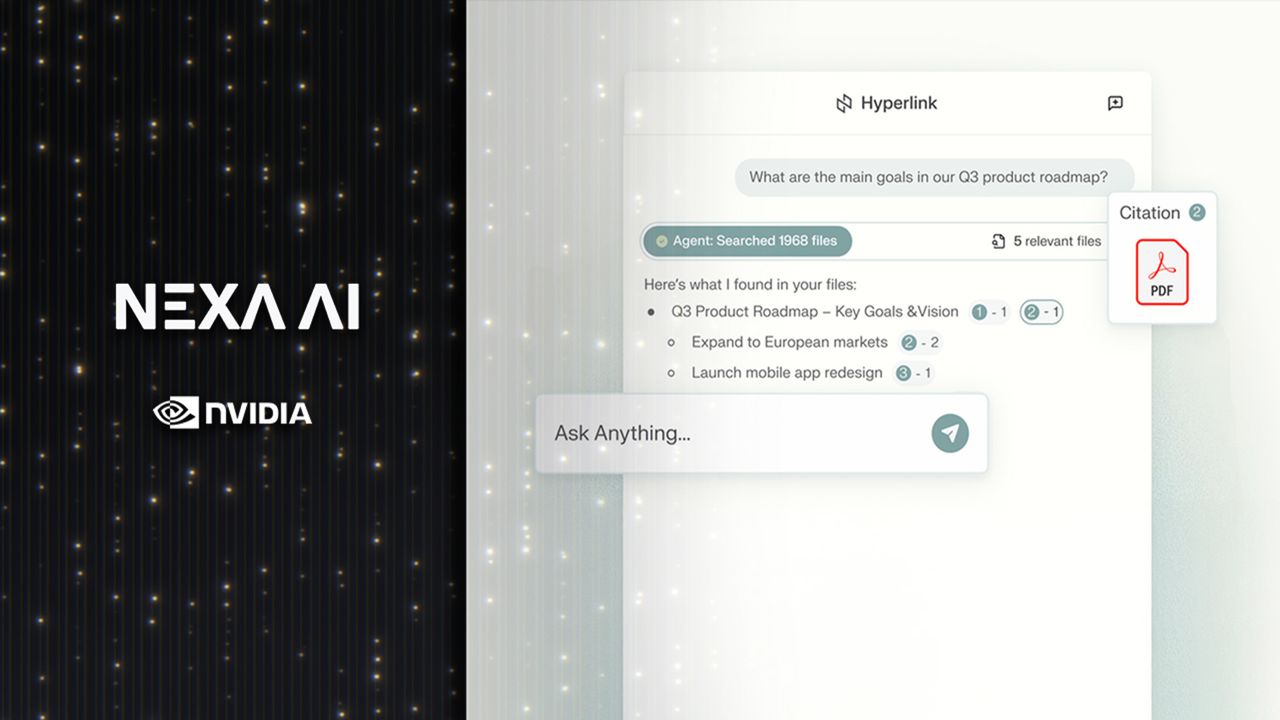

Agen “Hyperlink” baru Nexa.ai memperkenalkan pendekatan pencarian AI yang sepenuhnya berjalan pada perangkat keras lokal.

Dirancang untuk Nvidia PC RTX AI, aplikasi ini berfungsi sebagai asisten di perangkat yang mengubah data pribadi menjadi wawasan terstruktur.

Nvidia diuraikan bagaimana alih-alih mengirimkan pertanyaan ke server jarak jauh, ia memproses semuanya secara lokal, menawarkan kecepatan dan privasi.

Intelijen swasta dengan kecepatan lokal

Hyperlink telah diukur pada sistem RTX 5090, yang dilaporkan memberikan pengindeksan hingga 3x lebih cepat dan 2x lebih cepat. model bahasa besar kecepatan inferensi dibandingkan dengan versi sebelumnya.

Metrik ini menunjukkan bahwa alat ini dapat memindai dan mengatur ribuan file di seluruh komputer dengan lebih efisien dibandingkan kebanyakan alat AI yang ada.

Hyperlink tidak hanya mencocokkan istilah pencarian, karena ia menafsirkan maksud pengguna dengan menerapkan kemampuan penalaran LLM ke file lokal, memungkinkannya menemukan materi yang relevan bahkan ketika nama file tidak jelas atau tidak terkait dengan konten sebenarnya.

Peralihan dari pencarian kata kunci statis ke pemahaman kontekstual sejalan dengan semakin berkembangnya integrasi AI generatif ke dalam kehidupan sehari-hari alat produktivitas.

Sistem juga dapat menghubungkan ide-ide terkait dari beberapa dokumen, menawarkan jawaban terstruktur dengan referensi yang jelas.

Tidak seperti kebanyakan asisten berbasis cloud, Hyperlink menyimpan semua data pengguna di perangkat, sehingga file yang dipindai, mulai dari PDF dan slide hingga gambar, tetap bersifat pribadi, memastikan tidak ada informasi pribadi atau rahasia yang keluar dari komputer.

Model ini menarik bagi para profesional yang menangani data sensitif yang masih menginginkan keunggulan kinerja AI generatif.

Pengguna mendapatkan akses ke respons kontekstual yang cepat tanpa risiko paparan data yang menyertai penyimpanan atau pemrosesan jarak jauh.

Pengoptimalan Nvidia untuk perangkat keras RTX melampaui kinerja pencarian, karena perusahaan mengklaim generasi augmented pengambilan (RAG) kini mengindeks folder data padat hingga tiga kali lebih cepat.

Koleksi 1GB yang biasanya membutuhkan waktu hampir 15 menit untuk diproses kini dapat diindeks dalam waktu sekitar 5 menit.

Peningkatan kecepatan inferensi juga berarti respons muncul lebih cepat, sehingga tugas sehari-hari seperti persiapan rapat, sesi belajar, atau analisis laporan menjadi lebih lancar.

Hyperlink menggabungkan kenyamanan dengan kontrol dengan menggabungkan penalaran lokal dan akselerasi GPU, menjadikannya berguna alat AI untuk orang yang ingin menjaga privasi datanya.

Ikuti TechRadar di Google Berita Dan tambahkan kami sebagai sumber pilihan untuk mendapatkan berita, ulasan, dan opini pakar kami di feed Anda. Pastikan untuk mengklik tombol Ikuti!

Dan tentu saja Anda juga bisa Ikuti TechRadar di TikTok untuk berita, review, unboxing dalam bentuk video, dan dapatkan update rutin dari kami Ada apa juga.